テスラのフルセルフドライビング性能に対する懸念

Overview

- テスラのフルセルフドライビング(FSD)システムは、驚くべきことに13マイルごとに人間の介入が必要で、大きな安全性の懸念を引き起こしています。

- 独立したテストでは、赤信号を無視したり、対向車線に進入するという危険な挙動が明らかにされました。

- ドライバーの自己過信が大きなリスクをもたらし、多くのユーザーがこのシステムの限界を理解していないのが現状です。

南カリフォルニアでの徹底的なテスト

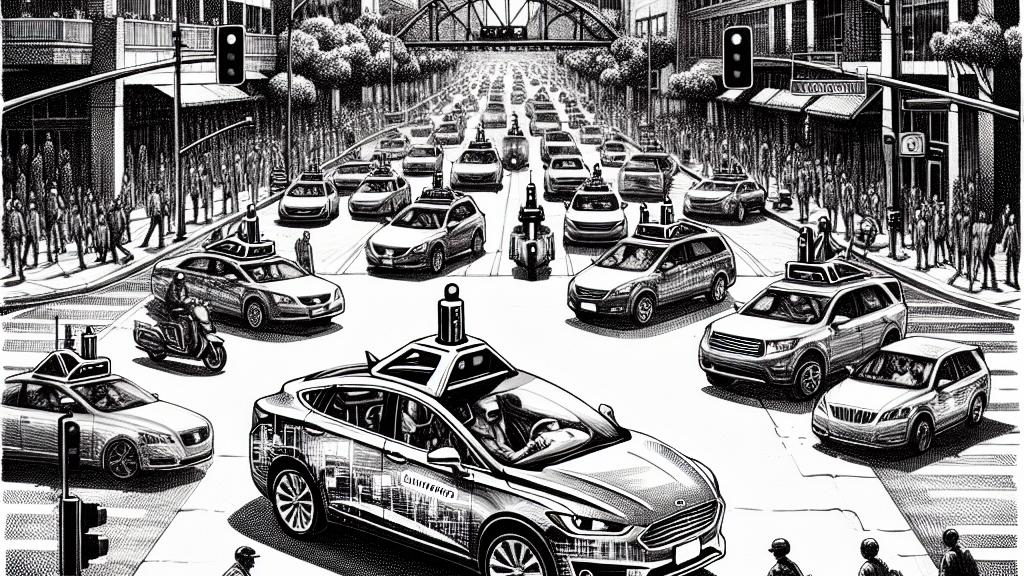

南カリフォルニアの bustlingな道路で実施されたAMCIテスティングによる詳しい評価は、テスラのフルセルフドライビング(FSD)システムに関する衝撃的な事実を明らかにしました。このテストでは、なんと1,000マイルの走行中に人間の介入が必要なケースが75件を超え、1回の介入は平均して約13マイルごとに発生しています。この頻度は、ユーザーにとって非常に心配です。FSDシステムは特に交通の流れを円滑にし、歩行者に道を譲るという優れた能力を示しましたが、一方で赤信号を無視したり、急に対向車線に侵入するなどの危険な行動も発生しました。これらの出来事は、進歩が見られる一方で、真の自律運転にはまだ多くの課題が残っていることを強く示しています。

ドライバーの自己過信の危険性

テスト中に顕著となったもう一つの懸念は、ドライバーの自己過信がもたらす深刻な危険です。FSDシステムが稼働すると、ドライバーはしばしば過剰な安心感を抱き、ハンドルから手を離す傾向があります。例えば、あるドライバーは全くの無防備でハンドルから手を外し、システムに完全に依存してしまっています。しかし、これが引き起こす危険は非常に高いのです。予期しない悪天候や道路状況の急な変化に直面したとき、システムが機能しない可能性があるため、迅速な人間による介入が必要になります。AMCIテスティングのディレクター、ガイ・マンジアメルは、どんなに熟練したドライバーであっても、常に注意を怠ってはならないと警告しています。技術は常に信頼できるわけではないからです。このように、一見進化した自動運転技術が、気を抜くことで瞬時に危険に変わることがあり得るのです。

展望:テスラのFSD向上への道

テスラのFSDの未来を考えると、完全自律運転への挑戦は素晴らしいものではありますが、その道のりには多くの障害が存在します。特に迫るロボタクシーの展開を控え、専門家はテスラが車両の安全性を高めるための改善策を講じる必要があると強調しています。テストから得られた不安定なデータは、FSD技術の本質的な課題と、機械学習の複雑さに起因しています。そのため、消費者の信頼を勝ち取るためには、テスラがこれらの脆弱性に果敢に取り組むことが求められます。そして、彼らの先見性のある技術を信頼できる運転体験に磨き上げ、約束を果たすことが何よりも大切なのです。

Loading...