メモリマジック:計算をメモリ内で行うことでAI推論が永遠に変わる!

Overview

- 計算をメモリ内で行う(CIM)は、計算とメモリを直接結びつける革命的な変化を象徴し、前例のない処理効率を実現します。

- この革新技術は、データの移動を大幅に削減し、今までにない速度と能力を大規模言語モデル(LLM)にもたらします。

- この技術的な跳躍の瀬戸際にいる私たちにとって、AI推論の未来はより速く、賢く、そしてよりアクセス可能であることを約束しています。

大規模言語モデルの挑戦

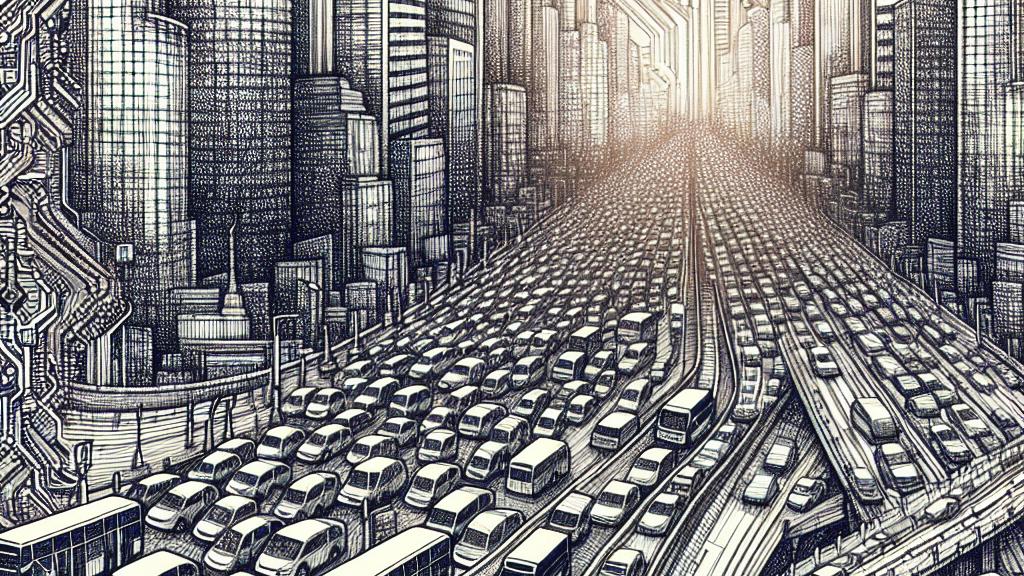

人工知能の世界は急速に進化しており、OpenAIのGPT-4oやAnthropicのClaude 3.5といった大規模言語モデル(LLM)がその先頭を切っています。これらのモデルは、まるで知性を持った友人のように、しばしば人間らしいテキストを生成する能力を発揮します。しかし、成長するにつれて彼らには新たな課題が浮かび上がります。特に、これらのモデルは膨大な計算リソースを必要とし、それに伴って苛立たしい遅延が生じることがしばしばです。この現象は「メモリの壁」と呼ばれています。想像してみてください。繁忙な都市の交通渋滞に巻き込まれているとき、重要なサービスがスムーズに運ばれず、時間がかかる様子を。メモリにアクセスするのが遅くなるほど、AIは動作が鈍くなり、効率も下がります。したがって、このメモリの壁を突破することは、単なる技術的な課題ではなく、AI技術の持続可能な進化に向けた重要なステップなのです。

計算をメモリ内で行う技術

では、計算をメモリ内で行う(CIM)技術について見てみましょう。この技術は、農産物を長いサプライチェーンを介さずに市場で手に入れることができるような利便性を提供します。CIMの利点は、計算がメモリユニット内で直接行われるため、データ転送による遅延が大幅に削減される点です。これは、混雑した高速道路が高架道路に変わることで、トラフィックがスムーズに流れるイメージです。この変化により、処理時間は劇的に短縮され、電力消費も抑えられます。CIMはまさに、このように現実のアプリケーションにおいてLLMのパフォーマンスを向上させる魅力的な選択肢です。さまざまなCIMアーキテクチャを分析する中で、その潜在能力が現代のAIの効率性を再定義する力を持つことが次第に明らかになります。

AI推論の未来

未来を展望すると、AI推論の可能性は無限に広がります。特に、CIMがその中心的な役割を担うことになるでしょう。迅速で効率的なAI処理への需要が高まる中で、CIMの役割はますます重要になってきます。想像してみてください。AIシステムがあたかもオーケストラのように、完璧なハーモニーで動作する未来を。このビジョンは、まさにCIMが導くものです。市場の予測によると、LLMセクターは2024年には65億ドルから2033年にはなんと1400億ドルに達するという驚くべき成長が見込まれています。これは、CIM技術がこれらの進展を支えるうえで極めて重要な役割を果たすことを示しています。また、Groqのような先駆者たちは、超低遅延の推論ソリューションを提供することで新たな基準を設定し、将来のAI機能は迅速であるだけでなく、真の変革をもたらすものであるべきだと示しています。CIMを基盤とすれば、私たちはまずAIを改善し、さらにその本質を再発明する岐路に立っています。これはまさに、未来の技術革新を形作る新たな道を開くものなのです。

Loading...